NVIDIA 攜手儲存產業領導者發布針對 AI 時代的全新企業基礎設施

GTC—— NVIDIA 今天宣布推出NVIDIA AI 資料平台,這是一種可自訂的參考設計,領先的供應商正在使用它來建立一類新的 AI 基礎設施,以滿足要求苛刻的 AI 推理工作負載:由 NVIDIA 加速運算、網路和軟體支援的具有 AI 查詢代理程式的企業儲存平台。

使用 NVIDIA AI 資料平台,NVIDIA 認證的儲存提供者可以建立基礎設施,以使用專門的 AI 查詢代理來加速 AI 推理工作負載。這些代理商利用NVIDIA AI Enterprise軟體(包括用於具有推理能力的新型NVIDIA Llama Nemotron 模型的NVIDIA NIM ™ 微服務)以及新的NVIDIA AI-Q Blueprint,幫助企業近乎即時地從資料中產生洞察。

儲存供應商可以優化其基礎設施,使用NVIDIA Blackwell GPU、NVIDIA BlueField ® DPU、NVIDIA Spectrum-X ™網路和NVIDIA Dynamo開源推理庫為這些代理程式提供支援。

領先的資料平台和儲存供應商(包括DDN、戴爾科技、惠普企業、日立 Vantara、IBM、NetApp、Nutanix、Pure Storage、VAST Data和WEKA)正在與 NVIDIA 合作創建客製化的 AI 資料平台,該平台可以利用企業資料來推理和回應複雜的查詢。

NVIDIA 創辦人兼執行長黃仁勳表示:「資料是人工智慧時代推動各行各業發展的原料。「我們正在與全球儲存領導者合作,建構企業需要在混合資料中心部署和擴展代理 AI 的新型企業基礎設施。 」

NVIDIA AI 資料平台為儲存添加加速運算和 AI

NVIDIA AI 資料平台為數百萬使用企業儲存來儲存推動公司發展的資料的企業帶來加速運算和 AI。

NVIDIA Blackwell GPU、BlueField DPU 和 Spectrum-X 網路提供了加速引擎,以加速 AI 查詢代理程式對儲存在企業系統上的資料的存取。 BlueField DPU 的效能比基於 CPU 的儲存高出 1.6 倍,同時將功耗降低高達 50%,每瓦效能提高 3 倍以上。 Spectrum-X 透過應用自適應路由和擁塞控制,與傳統乙太網路相比,AI 儲存流量加速高達 48%。

AI 資料平台儲存基礎架構使用NVIDIA AI-Q 藍圖來開發能夠推理和連接企業資料的代理系統。 AI-Q 利用NVIDIA NeMo Retriever™ 微服務,在 NVIDIA GPU 上將資料擷取和擷取速度提高高達 15 倍。

使用AI-Q Blueprint建構的 AI 查詢代理在推理過程中連接到數據,以提供更準確、更能感知上下文的回應。它們可以快速存取大規模數據並處理各種數據類型,包括來自多個來源的結構化、半結構化和非結構化數據,包括文字、PDF、圖像和影片。

儲存產業領導者與 NVIDIA 合作建置 AI 資料平台

NVIDIA 認證的儲存合作夥伴正在與 NVIDIA 合作建置客製化的 AI 資料平台。

- DDN正在將 AI 數據平台功能融入其 DDN Infinia AI 平台。

- 戴爾正在為其 Dell PowerScale 和 Project Lightning 解決方案系列建立 AI 資料平台。

- 惠普企業正在將 AI 資料平台功能注入 HPE AI 私有雲、HPE Data Fabric、HPE Alletra Storage MP 和 HPE GreenLake 檔案儲存。

- Hitachi Vantara將 AI 資料平台引入 Hitachi IQ 生態系統,幫助客戶利用儲存系統和資料產品進行創新,從而實現切實的 AI 成果。

- IBM正在將 AI 資料平台作為其內容感知儲存功能的一部分與 IBM Fusion 和 IBM Storage Scale 技術相集成,以加速檢索增強生成應用程式。

- NetApp正在利用基於 AI 資料平台建置的 NetApp AIPod 解決方案推動代理 AI 的企業儲存發展。

- Nutanix雲端平台與 Nutanix 統一儲存將與 NVIDIA AI 資料平台集成,並支援跨邊緣、資料中心和公有雲部署推理和代理工作流程。

- Pure Storage將透過 Pure Storage FlashBlade 提供 AI 資料平台功能。

- VAST Data正在與 AI 資料平台合作,利用 VAST InsightEngine 整理即時洞察。

- WEKA資料平台軟體與 NVIDIA GPU、DPU 和網路集成,以優化代理 AI 推理和洞察的資料訪問,並提供高效能儲存基礎,以加速 AI 推理和令牌處理工作負載。

NVIDIA 認證的儲存供應商計劃從本月開始提供使用 NVIDIA AI 資料平台建立的解決方案。

觀看NVIDIA GTC 主題演講以了解更多信息,並註冊參加NVIDIA 和行業領袖在展會上的演講,該展會將持續至 3 月 21 日

加速企業洞察:Pure Storage 與 NVIDIA AI 資料平台協助大規模精準推理

延遲洞察意味著錯失機會。透過 Pure Storage 支援的 NVIDIA AI 資料平台,組織可以將大量資料轉化為即時情報。

概括

在當今快節奏的商業世界中,毫秒都至關重要。 NVIDIA AI 資料平台與 FlashBlade//EXA 和 Portworx 集成,使組織不僅能夠加速推理,還能大規模解鎖精確推理。

對於具有複雜 AI 推理需求的大型客戶,採用 Pure Storage ® FlashBlade//EXA ™ 和Portworx ®實現的 NVIDIA AI 資料平台參考設計重新定義了組織如何將大量資料轉化為即時情報。這個全面的堆疊不僅可以加速推理,還可以解鎖大規模的精確推理,使大型企業能夠以手術精度解碼複雜資料集,同時保持生產級安全性。

情報的必要性:速度和精度為何如此重要

現代企業在這樣的環境中運作:延遲洞察等於錯失機會。NVIDIA AI 資料平台的 Pure Storage 實施透過將加速運算與智慧資料編排結合來解決此問題,在企業知識和 AI 推理之間建立回饋循環。從本質上講,該基礎設施能夠實現:

- 以亞秒延遲即時分析多模態資料(文字、影像、影片)

- 跨分佈式資料集的上下文感知推理

- 透過細粒度的安全控制實現可信賴的洞察和資料治理

透過利用NVIDIA Blackwell、NVIDIA 網路、檢索增強生成 (RAG)軟體(包括NVIDIA NeMo Retriever微服務和AI-Q NVIDIA Blueprint)以及 Pure Storage 的元資料優化架構的加速運算,組織可以將洞察時間從幾天縮短到幾秒鐘,同時在生產環境中保持非常高的推理準確性。

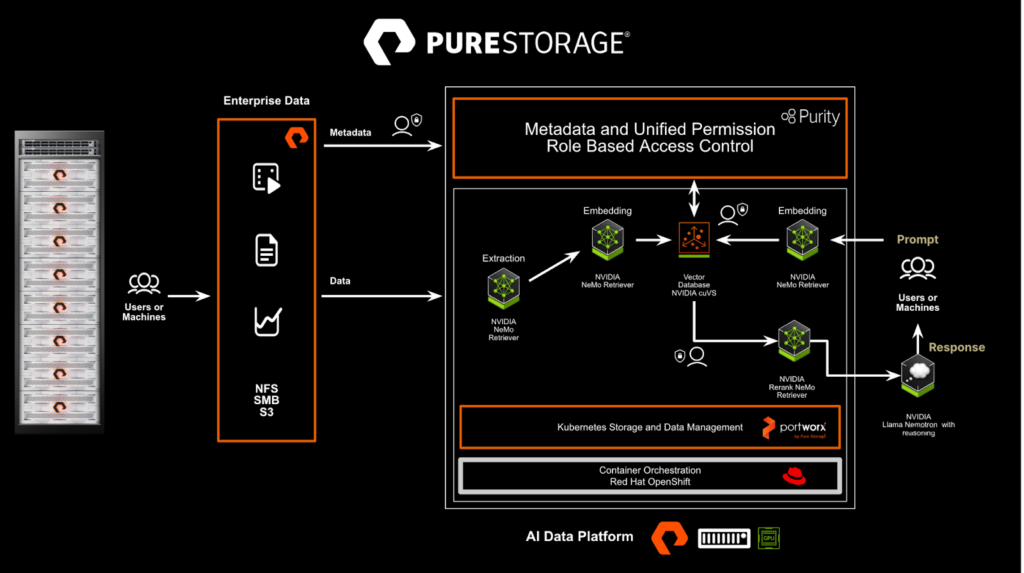

圖 1.Pure Storage 實施的 NVIDIA AI 資料平台。

FlashBlade//EXA:資料速度引擎

Pure Storage FlashBlade//EXA 打破了傳統儲存瓶頸,在單一命名空間中實現了 10+ TB/s 的吞吐量效能,足以在三分鐘內處理美國國會圖書館的全部藏書。

資料和元資料節點的分解如何實現大規模推理

FlashBlade//EXA 分解設計的關鍵優勢在於能夠獨立擴展元資料和資料效能。這意味著組織可以將其儲存架構與其推理工作負載的特定需求精確匹配,而無需過度配置任何一個元件。

對於需要快速存取數千或數百萬個較小檔案的推理工作負載,可以適當地擴展元資料層。類似地,對於處理由巨型檔案組成的海量資料集的工作負載,可以擴展資料層,而無需不必要的元資料開銷。這種靈活性實現了「幾乎無限的可擴展性」。

元資料和資料處理的分離提供了無阻塞資料訪問,這在高效能運算場景中變得越來越有價值,在高效能運算場景中,元資料操作可以等於甚至超過實際資料 I/O 操作。這種架構可確保 GPU 始終以最高的速率傳輸數據,從而消除昂貴的空閒時間。

FlashBlade//EXA 憑藉其分解式、大規模並行架構,解決了擴大 AI 工作負載的問題,消除了 GPU 的閒置時間,因此企業可以加速 AI 訓練和推理。這種高效的資料傳輸對於推理工作負載至關重要,因為一致性、可預測的效能通常比尖峰速度更重要,而這可以透過針對突發和混合工作負載的高效 KV 快取共享來實現。

Portworx 與 FlashBlade//EXA 協同作用,實現推理加速

Portworx 和 FlashBlade//EXA 之間的協同作用透過將 Portworx Kubernetes 原生資料管理和智慧模型快取與 FlashBlade//EXA 超快速、大規模並行儲存架構相結合,加速了大規模 AI 推理。 Portworx 確保高可用性、低延遲存取以及跨分散式推理工作負載的模型資料的無縫擴展,而 FlashBlade//EXA 則透過卓越的吞吐量和分解擴展消除了儲存和元資料瓶頸。它們共同最大限度地提高 GPU 利用率,最大限度地減少推理延遲,並為在生產環境中部署和管理 AI 推理管道提供強大、靈活的基礎。

分解式鍵值快取的革命:規模精度

NVIDIA 的 KV Cache 架構透過三項創新重新構想了推理管道:

- 近 GPU 前綴緩存

- 將常見查詢模式(例如,法規遵循檢查)直接儲存在 GPU 相鄰的 NVMe 中

- 負載感知調度

- 根據查詢複雜性動態分配預填/解碼資源

- 即使在流量高峰期間也能維持 95% 的 GPU 利用率

- 異質 GPU 池化

- 支援混合 GPU 變體集群共享 KV 快取內存

Pure Storage 解決方案透過以下功能對上述內容進行了補充,為大規模 AI 推理部署提供了每秒令牌效能的端到端加速。

- KV 快取共享:確保在指數級成長的群體中實現高效的 KV 快取共享。

- 高IO並發:FlashBlade®的高並發架構不僅速度超快,而且在指數級並發IO模式中表現出色。

- 資料縮減: KV快取的自動壓縮意味著更快的IO和更短的預填充時間。

安全性作為推動因素:RBAC 在 RAG 和 Agentic AI 中實現可信賴洞察

在檢索增強生成 (RAG) 或代理管道中實施基於角色的存取控制 (RBAC) 框架對於安全且高效的資料處理至關重要。這涉及建立統一的權限層來定義使用者角色及其在各個階段的存取權限:資料提取、檢索、處理和儲存。此外,組件必須支援高效的查詢理解,以根據使用者角色和意圖自訂資料訪問,確保符合設定的權限。人工智慧增強和生成過程必須在生成模型中整合特定於上下文的數據,同時維護安全性和存取協議。有效的稽核和監控機制對於追蹤存取模式和確保遵守 RBAC 規則、提高整體安全性至關重要。安全最佳實踐(例如採用零信任模型和基於 JWT 的身份驗證)強調瞬態和安全的存取控制,同時最大限度地減少對管道性能的影響。

Portworx 實作了零信任安全模型,可以加速而不是抑制資料存取:

- StorageClass 細粒度加密:加密傳輸中和靜止狀態下的敏感 PII,同時保持訓練資料的可存取性

- 基於 JWT 的存取控制:授予對 RAG 管道的臨時、上下文感知存取權限

- 符合審計的日誌記錄:追蹤從原始攝取到推理輸出的資料沿襲

NVIDIA AI-Q:推理智能層

AI-Q NVIDIA Blueprint透過三個核心元件將靜態資料轉化為動態知識:

- 多模式提取引擎:將 PDF 示意圖、服務手冊和通話記錄轉換為結構化知識圖

- NeMo Retriever 微服務:在十億向量搜尋中實現極高的召回率

- NVIDIA 代理智慧工具包編排:複雜代理系統的分析與最佳化

當與 FlashBlade//EXA 的資料速度結合時,該堆疊可以實現我們所說的「精確推理」——能夠在極少的查詢週期內從原始資料中獲得董事會所需的見解。

大規模精準推理:新的競爭優勢

採用此堆疊的企業報告了變革性成果。

NVIDIA AI 資料平台的 Pure Storage 實現提供了極致的推理密度——能夠從每 TB 的處理中提取更多可操作的見解。透過將 NVIDIA Blackwell 加速運算與 Pure Storage 的資料可存取性相結合,組織實現了以前無法想像的事情:將其整個資料資產轉變為策略推理資產。

結論:以業務速度實現智慧化

Pure Storage 與 NVIDIA 的合作不僅代表著超大規模的 AI 基礎設施——我們長期的合作歷史確保各種規模和 AI 成熟度的客戶都能得到支持,無論他們是剛開始使用FlashBlade//S或AIRI ®,還是擴展到最高級別的AI和HPC要求。

隨著人工智慧從實驗項目轉變為核心收入驅動因素,該平台為持續智慧提供了基礎——以機器精度對即時數據流進行推理、決策和採取行動的能力。未來屬於那些不僅儲存數據,而且能夠以思維速度理解數據的企業。

Pure Storage 將 NVIDIA AI 資料平台整合至 FlashBlade,協助企業 AI 創新

FlashBlade 現已獲得 NVIDIA Cloud Partner 和 Enterprise 部署認證,可將資料近乎即時地轉化為知識,加速代理 AI 推理

加州聖克拉拉,2025 年 3 月 18 日/PRNewswire/ -- Pure Storage® (NYSE: PSTG),提供全球最先進資料儲存技術和服務的 IT 先驅,今天宣布將 NVIDIA AI 資料平台參考設計整合到其 FlashBlade ®平台中,擴大其承諾,為符合 NVIDIA AI 資料平台參考設計整合到其 FlashBlade ®平台中,擴大其承諾,為符合 NVIDIA AI 資料平台參考設計整合到其 FlashBlade ®平台中,擴大其承諾,為符合 NVIDIA AI 資料平台參考設計整合到其 FlashBlade ®平台中,擴大其承諾,為符合 NVIDIA AI 的標準的企業提供可擴充

新聞重點:

Pure Storage 正在透過增強企業客戶管理成功部署 AI 所需的高效能資料和加速運算需求的能力來推進企業資料儲存和管理,其中包括:

- 透過 Pure Storage FlashBlade 提供 NVIDIA AI 數據平台功能: FlashBlade支援NVIDIA 用於構建智慧 AI 數據平台的全新參考設計,使客戶能夠在 AI 時代提升存儲,使其成為一個高性能分佈式系統,可快速從數據中提供業務洞察。透過利用 NVIDIA 加速運算、網路和NVIDIA AI Enterprise軟體,FlashBlade 可以以 AI 推理應用程式所需的速度和靈活性處理資料。

此公告是在 Pure Storage 推出 FlashBlade//EXA™ 之後發布的,FlashBlade//EXA™ 是業界效能最高的資料儲存平台,專為滿足人工智慧和高效能運算最嚴苛的要求而設計。

- 獲得 NVIDIA 合作夥伴網路雲端合作夥伴的高效能儲存 (HPS) 平台認證: Pure Storage 現已正式獲得 NVIDIA 雲端合作夥伴參考架構的 HPS 認證,該架構採用使用NVIDIA B200或 H200 GPU 的NVIDIA HGX系統,進一步加強了我們與 NVIDIA 的合作。此項認證認可了 Pure Storage 是值得信賴的儲存合作夥伴,並證實了 Pure Storage 能夠透過經過驗證的參考架構支援NVIDIA 雲端合作夥伴,該架構滿足建置最先進 GPU 雲端的所有效能和技術要求。

- 獲得基礎級和企業級NVIDIA 認證儲存合作夥伴批准,展示企業 AI 工廠的能力: NVIDIA 認證儲存系統透過提供全面的儲存認證,滿足 AI 工廠的海量資料需求。它嚴格測試儲存系統,以確保它們符合最高的品質、效率和可靠性標準。該計劃是 NVIDIA 認證™ 系統和 NVIDIA 企業參考架構 (RA) 的補充,使合作夥伴和客戶能夠高效部署 AI 基礎架構。透過將經過驗證的儲存與 NVIDIA 的加速運算和軟體技術相結合,客戶可以自信地建立 AI 工廠,利用數據實現更快、更準確、更可靠的 AI 模型,釋放新的可能性並推動各行各業的創新。

加上 Pure Storage 最近通過NVIDIA DGX SuperPOD對FlashBlade//S500的認證,這些新認證為 NVIDIA 雲端合作夥伴和企業提供了滿足建置最先進 AI 基礎設施的所有要求的高效能儲存。透過利用 Pure Storage,客戶可以自信地部署 AI 工廠基礎設施,同時確保效能和可擴展性。

客戶影響

大規模 AI 和 ML 工作負載的出現推動了 GPU 雲端供應商的快速成長,他們正在擴展基礎設施以滿足企業對加速運算的需求。企業 AI 專案依賴高效能儲存系統來跟上模型訓練、推理和檢索增強生成 (RAG) 工作流程的速度和規模。然而,傳統的儲存解決方案通常會限制 GPU 的效率,造成資料存取瓶頸並直接影響結果時間。此外,這些傳統的儲存架構增加了管理大規模儲存的複雜性,並難以應對多租戶環境,從而增加了營運效率低下和安全漏洞的風險。

透過 Pure Storage,組織可以部署與 NVIDIA 加速運算相容的儲存解決方案,並消除實際投資回報率和 GPU 工作負載效率的障礙。 Pure Storage 平台消除了瓶頸,無縫處理多租戶,同時促進始終在線的服務品質 (QoS)。 Pure Storage 提供具有進階讀取/寫入效能保證的解決方案,可加速 AI 工作負載的大規模訓練和推理。 Pure Storage 還平衡了全面且強大的資料儲存和易於管理的介面,進一步消除了與傳統儲存系統相關的常見複雜性。

高階主管見解

Pure Storage 首席技術官 Rob Lee 表示:「 GPU 已迅速成為下一波 AI 創新浪潮的驅動力。NVIDIA AI 數據平台與 FlashBlade 的整合,提供了實現峰值性能所需的 AI 就緒型存儲。此外,我們最近獲得的 NVIDIA 認證,也證明了 Pure Storage能夠支持 AI 模型實現變革

NVIDIA 儲存網路技術副總裁 Rob Davis 表示:“新一波 AI 推理將由海量數據集驅動,並需要始終在線的數據處理流程。通過將 NVIDIA AI 數據平台功能集成到 Pure Storage FlashBlade 中,企業可以為 AI 代理配備近乎實時的業務數據,從而實現全新水平的個性化客戶服務、運營效率和前所未有的業務數據”

思科運算業務總經理兼高級副總裁 Jeremy Foster 表示:「對於客戶而言,更便捷的大規模部署 AI 途徑意味著更低的複雜性和更快的創新速度。正因如此,思科與 Pure Storage 等領先企業合作,憑藉 FlashBlade//EXA 等產品以及對 NVIDIA 全新參考設計的支持,不斷突破 AI 資料儲存的數據的先進儲存系統相集成,幫助企業簡化 AI 工作負載,釋放其數據的全部潛力。

Nvidia Dynamo 和儲存下一代產品將提升 AI 儲存效能並降低成本

在 2025 年 Nvidia GPU 技術大會上,該公司宣布了其 AI 資料平台,該平台在企業數位儲存方面取得了重大進展,以支援企業 AI 工作負載。然而,該公司 Dynamo 軟體中的 KV 快取以及未來將儲存和記憶體與 GPU 更直接連接的努力將進一步推動數位儲存和記憶體需求,提高推理效能並降低 AI 成本。

AI 資料平台利用 Blackwell GPU、BlueField DPU 和 Spectrum-X 網絡,提供比基於 CPU 的儲存高 1.6 倍的效能,將功耗降低高達 50%,並提供三種以上的每瓦效能,並且與傳統乙太網路相比,儲存流量加速高達 48%。此次推出是與

在最近與 Nvidia 的 Kevin Deierling 的對話中,我們討論了與 2025 GTC 存儲公告相關的另一個主題,即 Nvidia Dynamo 中的鍵值緩存,請參見下面的 Jensen 宣布 Dynamo 的圖片。

Jensen 將 Dynamo 描述為 AI 工廠的作業系統。這些關鍵值是某個時間點 AI 模型狀態的二進位表示。對於大型模型來說,這個 KV 快取會變得非常大。但KV快取可以讓使用者回應更快,避免重新計算模型結果,進而降低成本,提高效率。

Nvidia Dynamo 是一款開源高吞吐量低延遲推理軟體,旨在標準化模型部署並實現生產中快速且可擴展的 AI。由於為使用者要求建立經過訓練的 KV 值需要大量運算,並且將它們僅保存在 GPU 記憶體中成本高昂,因此 Dynamo KV Cache Manager 可以將較舊或不常存取的 KV 快取區塊卸載到更具成本效益的記憶體和儲存中,例如 CPU 記憶體、本機儲存或網路物件或檔案儲存。

Nvidia 和多家數位儲存和記憶體公司正在進行另一項名為 Storage Next 的合作。這是開放運算專案的一項計劃,旨在使用 PCIe 第六代總線上的下一代 NVMe,為 GPU 運算創建一種新的儲存架構,用於分解資料保護、託管區塊儲存的記憶體。預計這將降低整體擁有成本、提高 IOPS、降低功耗、減少基礎設施複雜性並減少尾部延遲的影響。

凱文對我的評論是,這將包括人工智慧的運算儲存。 Nvidia 計劃在 8 月的 2025 FMS 上進一步討論這項努力。

Nvidia 的 Dynamo 透過可擴展的數位儲存和記憶體分層 KV 快取實現更快、更有效率的 AI 推理。儲存產業的開發工作將使數位儲存與 GPU 的整合更加緊密。